Боевой ИИ в войнах и вооружённых конфликтах ближайшего будущего

Вопросы применения искусственного интеллекта (ИИ) для ведения с его помощью боевых действия возникли, наверное, с того самого момента, как появилось само понятие ИИ, причём даже не в научной среде, а в жанре фантастики.

Сейчас, казалось бы, перспективная тематика во многом превратилась в показуху на популярную тему – многие вспомнят, что лет десять назад было то же самое, только вместо словосочетания «искусственный интеллект» использовалось слово «нанотехнологии» (кстати, тематика нанотехнологий и сейчас не потеряла свою актуальность и перспективность просто стала «немодной»).

Сегодня мы поговорим о реалистичных перспективах использования ИИ в вооружённых силах (ВС) в ближайшей перспективе.

Сильный и слабый

Если мы говорим о искусственном интеллекте, то в первую очередь необходимо различать сильный и слабый ИИ.

Сильный ИИ – это искусственный интеллект, чьи когнитивные способности будут сопоставимы или превосходить таковые у человека. Слабый ИИ – это то, что мы имеем сейчас – чаще всего мы сталкиваемся с ним в быту в виде различных нейросетей, отвечающих на вопросы или рисующих изображения, некоторые из которых как раз и приведены в данном материале.

Основное отличие слабого ИИ от сильного состоит в том, что слабый ИИ не осознаёт своих действий, не понимает, что он делает – некоторые сравнивают существующие слабые ИИ с мозгом маленького ребёнка или собаки, но это в корне неверно.

Кроме того, у слабого ИИ отсутствуют эвристические способности, то есть он не может создать что-то совершенно новое – лишь компиляцию из того, что он изучил ранее, кстати, именно из-за этого сейчас возникают проблемы с обучением нейросетей – они просто уже изучили почти все доступные, аккумулированные человечеством данные.

До сих пор ведутся споры о том, можно ли в принципе создать сильный ИИ с помощью существующих «кремниевых» технологий. Как появляется мотивация и рождается потребность что-то творить? Не механически впитывать закачиваемые в ИИ знания, а самостоятельно формулировать вопросы и искать на них ответы – ведь это вопросы не только техники, но и философии, психологии.

С точки зрения применения в ходе войн и вооружённых конфликтов сильный ИИ стоит сразу вынести за скобки. Во-первых, на текущий момент сильный ИИ не существует, и нет никаких гарантированных сроков его создания, а все сроки, что заявлялись ранее, были неоднократно сорваны.

Во-вторых, появление сильного ИИ может настолько изменить окружающий мир, привести к последствиям такого масштаба, начиная от сингулярности и заканчивая планетарной катастрофой (причём не исключено, что эти события будут происходить одновременно), что рассуждать о применении сильного ИИ в качестве пилота танка или самолёта просто не имеет смысла.

Итак, мы говорим о слабом ИИ и его применении.

Индивидуальный подход

Все ведущие державы планеты так или иначе, но вкладываются в развитие ИИ, лидерами в данном направлении ожидаемо являются США и Китай.

США в развитии ИИ полагаются на работу с коммерческими структурами, например, феврале 2024 года компания Google официально отказалась от своего обязательства не разрабатывать ИИ для военного применения – как говорится, это бизнес – ничего личного. Также ВС США сотрудничают в области ИИ с такими компаниями, как OpenAI и Palantir.

В КНР основные работы в области боевого ИИ сосредоточены в государственных структурах, хотя можно предположить, что китайские частные компании тоже активно работают в этом направлении. Согласно докладу Вашингтонского университета в Брукингсе за 2020 год, Китай уже много лет инвестирует в системы оружия на основе ИИ.

США и Китай в первую очередь рассматривают применение ИИ именно на поле боя, вначале для повышения эффективности действий беспилотных вооружений, а затем и для обеспечения управления как беспилотными, так и пилотируемыми комплексами всех типов.

Вопрос скорее в том, в какой области его применение будет эффективно и оправданно, а в каких принесёт больше вреда, чем пользы?

Перемещение по поверхности

Казалось бы, эта сфера однозначно будет за ИИ, ведь в настоящее время десятки автомобильных компаний и стартапов разрабатывают всё более и более продвинутые автопилоты?

В реальности всё гораздо сложнее. Движение по дорогам общего пользования регламентировано достаточно строгими правилами, покрытие дороги (в нормальном случае) максимально качественное, нанесена разметка и установлены предупреждающие знаки. Но даже на дорогах общего пользования нередки нештатные ситуации, отреагировать на которые автопилот в лучшем случае может только полной остановкой, а в худшем – отправив транспортное средство в аварию.

А теперь представим, например, местность вблизи линии боевого соприкосновения (ЛБС) на Украине – задымление, воронки от взрывов, мины и так далее, и тому подобное. Много ли в такой ситуации сможет слабый ИИ? Ну, допустим, управляемое ИИ транспортное средство по дорогам общего пользования ещё как-то сможет передвигаться – передавит людей, машины и фонарные столбы, поотрывает все антенны и обомнёт бока, но что будет, когда ведомый ИИ танк выедет в поле в период осенней распутицы?

Скорее всего, далеко он не уедет – кто ещё не видел утопших в грязи танков?

Можно предположить, что в части управления наземными транспортными средствами боевой ИИ будет применяться лишь как средство подстраховки водителя, на коротком участке маршрута, например, когда боевой машиной управляют дистанционно и связь оказывается потеряна.

По наземным целям

Одним из предполагаемых направлений применения боевого ИИ является использование его для поражения наземных целей – неважно, с наземной боевой машины или с воздуха, например, с квадрокоптера.

Здесь также можно привести аналогию с гражданским применением – с одной стороны, сочетание современных сенсоров и развитого, пусть и слабого ИИ, с высокой вероятностью позволит осуществлять обнаружение типовых целей, распознавать наличие у них оружия и даже его тип.

С другой стороны, всё это будет работать лишь в том случае, если противник будет «играть в поддавки», то есть действовать шаблонно. А противник не будет – он будет маскироваться, скрывать очертания, применять ломаные линии в камуфляже, изменять форму оружия какими-либо чехлами.

Например, в ходе одних испытаний в США роботизированная турель с ИИ эффективно условно поражала атакующих её морпехов, однако всё это работало лишь до тех пор, пока бойцы не стали импровизировать – подползать к турели, прикрывшись картонной коробкой, прикрываться искусственным кустом и так далее, и тому подобное.

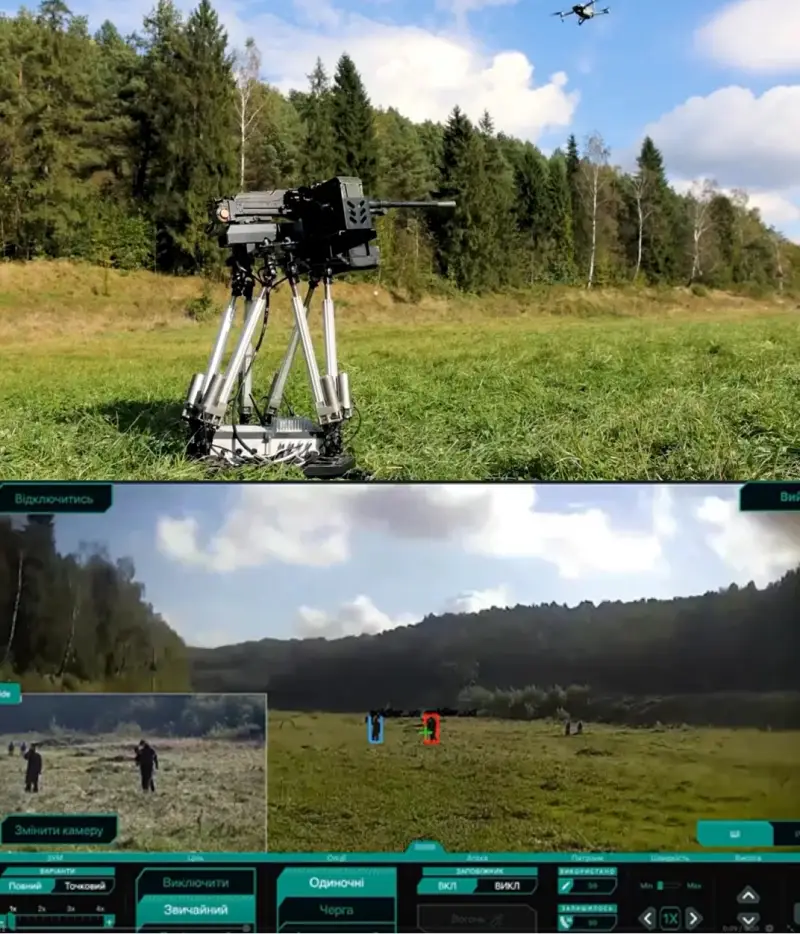

Турель для стрелкового оружия украинской компании devDroid.tech

Конечно, можно повысить «параноидальность» ИИ, однако тогда в полный рост встанет проблема поражения гражданских и дружественного огня – сильный ИИ всё равно глуп, при решении этой задачи даже люди часто ошибаются, а ИИ либо будет косить всех вокруг, включая своих, либо будет пропускать цели, которые будут пользоваться его слабостями.

Кстати, в марте 2020 года, в Ливии, действующий в автономном режиме турецкий беспилотный летательный аппарат (БПЛА) квадрокоптерного типа Kargu-2 убил человека без какого-либо участия оператора во время конфликта между ливийскими правительственными войсками и отколовшейся военной группировкой во главе с Ливийской национальной армией.

Можно не сомневаться – противник будет применять оружие с ИИ для атаки наземных целей, та же Украина, получив доступ к такому оружию, без колебаний отправит его куда-нибудь в Курскую область, установив для ИИ минимум ограничений – наши потери среди гражданских, да и гибель собственных бойцов, их абсолютно не волнуют, так что это необходимо учитывать.

Реалистичное и уже работающее применение ИИ – это донаведение на цель FPV-дронов в частности и БПЛА-камикадзе в целом на конечном участке полёта.

На Украине нередкой является ситуация, когда оператор теряет FPV-дрон буквально на последних метрах атаки из-за того, что средства радиоэлектронной борьбы (РЭБ) подавляют сигнал управления или видеоканал передачи данных. Однако в том случае, если на дроне присутствует интеллектуальная система наведения, то оператор просто осуществляет захват цели, а далее дрон наводится на неё самостоятельно, даже при потере сигналов управления.

По воздушным целям

Здесь ИИ будет уже немного проще. Начать можно с решения задачи по поражению таких целей, как FPV-дроны. В сети Интернет есть видео, на котором российский разведывательный БПЛА Zala автоматически уклоняется от атак украинского FPV-дрона, обнаружив его встроенной камерой (камерами?).

Российский разведывательный БПЛА Zala автоматически уклоняется от атак FPV-дрона противника

Уничтожение FPV-дронов может происходить схожим образом – какая-нибудь турель, например, такая как противодроновая турель, разрабатываемая фондом Лобаева, и система наведения, способная распознавать FPV-дроны и выдать команды приводам турели.

Конечно, ошибки возможны и при работе противодроновой турели, оснащённой ИИ, но люди ещё летать не научились, а так, ну да, птичку жалко... Впрочем, с этим тоже можно что-то сделать, например, учитывать специфический шум винтов или его отсутствие, ставить отпугиватели птиц, в общем – есть варианты.

Противодроновая турель, разрабатываемая фондом Лобаева

Если наш БПЛА может уклоняться от атак FPV-дронов противника, то то же самое может использоваться для решения обратной задачи – атаки воздушных целей противника. Фактически БПЛА будут охотиться на БПЛА – такие комплексы разрабатываются во многих странах мира, в том числе в России и на Украине.

Захват цели и самонаведение, работа противодроновых турелей и охота дронов на дроны – всё это уже достаточно зрелые технологии, которые уже применяются на поле боя или будут применяться в ближайшее время.

Рой

Тематика роевого применения дронов в последнее время активно исследуется. С одной стороны, коммерческие дроны на различных выступлениях показывают чудеса организации, однако в рамках таких шоу дронов они действуют в основном в соответствии с заложенной в них жёсткой программой.

Боевое применение потребует самоорганизующихся сетей, решения задач, например, когда цель не поражена одним дроном из стаи, то на неё перенаправляется другой дрон, и вот здесь нам уже потребуется достаточно продвинутый ИИ.

Можно предположить, что высокую эффективность роевое применение дронов с использованием ИИ покажет при работе по воздушным целям разных типов, например, при перехвате БПЛА-камикадзе большой дальности с помощью FPV-дронов. Что касается работы по наземным целям, то здесь скорее всего потребуется участие человека в контуре принятия решений, когда оператор (операторы) будут подтверждать или отклонять уничтожение обнаруженных ИИ целей.

Выводы

Сегодня мы поговорили о некоторых возможностях применения боевого ИИ – именно слабого ИИ, неспособного к полноценному самостоятельному рассуждению.

В ближайшей перспективе применение боевого ИИ для управления наземными транспортными средствами и поражения наземных целей будет достаточно ограниченно – слишком сложной является ситуация на поле боя, даже человек допускает много ошибок, а ведомая ИИ наземная боевая машина будет крошить всё вокруг – своих, чужих, гражданских, пока не попадётся на какую-то примитивную уловку противника или не утонет в грязи.

А вот как средство донаведения БПЛА-камикадзе на конечном участке полёта или как вспомогательное средство, подсказывающее человеку варианты принятия решения, боевой ИИ может быть очень полезен.

Кстати, о возможности информационной поддержки пилотов наземных боевых машин мы говорили ещё в 2019 году в материале Эргономика рабочих мест и боевые алгоритмы перспективных бронемашин.

Значительные перспективы имеются в части применения ИИ в сфере БПЛА – как сами дроны, так и средства борьбы с ними будут стремительно «умнеть», это неизбежно. Тот, кто не будет уделять этому направлению достаточно внимания, будет нести значительные потери.

В дальнейшем мы поговорим о перспективах применения ИИ для решения более масштабных задач – в авиации, во флоте, в контурах принятия решений, а также при решении других, весьма важных, но не столь очевидных задач.

Информация