Искусственный интеллект. Часть вторая: вымирание или бессмертие?

Перед вами вторая часть статьи из серии «Подождите, как это все может быть реальностью, почему до сих пор об этом не говорят на каждом углу». В предыдущей серии стало известно, что к людям планеты Земля постепенно подкрадывается взрыв интеллекта, он пытается развиться из узконаправленного до общечеловеческого интеллекта и, наконец, искусственного сверхинтеллекта.

Первая часть статьи началась довольно невинно. Мы обсудили узконаправленный искусственный интеллект (УИИ, который специализируется на решении одной конкретной задачи вроде определения маршрутов или игры в шахматы), в нашем мире его много. Затем проанализировали, почему так сложно вырастить из УИИ общенаправленный искусственный интеллект (ОИИ, или ИИ, который по интеллектуальным возможностям может сравниться с человеком в решении любой задачи). Мы пришли к выводу, что экспоненциальные темпы технического прогресса намекают на то, что ОИИ может появиться довольно скоро. В конце концов мы решили, что как только машины достигнут человеческого уровня интеллекта, может тут же произойти следующее:

Как обычно, мы смотрим на экран, не веря в то, что искусственный сверхинтеллект (ИСИ, который намного умнее любого человека) может появиться уже при нашей жизни, и подбирая эмоции, которые лучше всего бы отражали наше мнение по этому вопросу.

Прежде чем мы углубимся в особенности ИСИ, давайте напомним себе, что значит для машины быть сверхразумной.

Основное различие лежит между быстрым сверхинтеллектом и качественным сверхинтеллектом. Зачастую первое, что приходит в голову при мысли о сверхразумном компьютере, это то, что он может думать намного быстрее человека — в миллионы раз быстрее, и за пять минут постигнет то, на что человеку потребовалось бы лет десять. («Я знаю кунг-фу!»)

Звучит впечатляюще, и ИСИ действительно должен мыслить быстрее любого из людей — но основная отделяющая черта будет заключаться в качестве его интеллекта, а это совсем другое. Люди намного умнее обезьян не потому, что быстрее соображают, а потому что мозги людей содержат ряд хитроумных когнитивных модулей, которые осуществляют сложные лингвистические репрезентации, долгосрочное планирование, абстрактное мышление, на что обезьяны не способны. Если разогнать мозг обезьяны в тысячу раз, умнее нас она не станет — даже через десять лет она не сможет собрать конструктор по инструкции, на что человеку понадобилось бы пару часов максимум. Есть вещи, которым обезьяна никогда не научится, вне зависимости от того, сколько часов потратит или как быстро будет работать ее мозг.

Кроме того, обезьяна не умеет по-человечески, потому что ее мозг просто не в состоянии осознать существование других миров — обезьяна может знать, что такое человек и что такое небоскреб, но никогда не поймет, что небоскреб был построен людьми. В ее мире все принадлежит природе, и макака не только не может построить небоскреб, но и понять, что его вообще может кто-либо построить. И это результат небольшой разницы в качестве интеллекта.

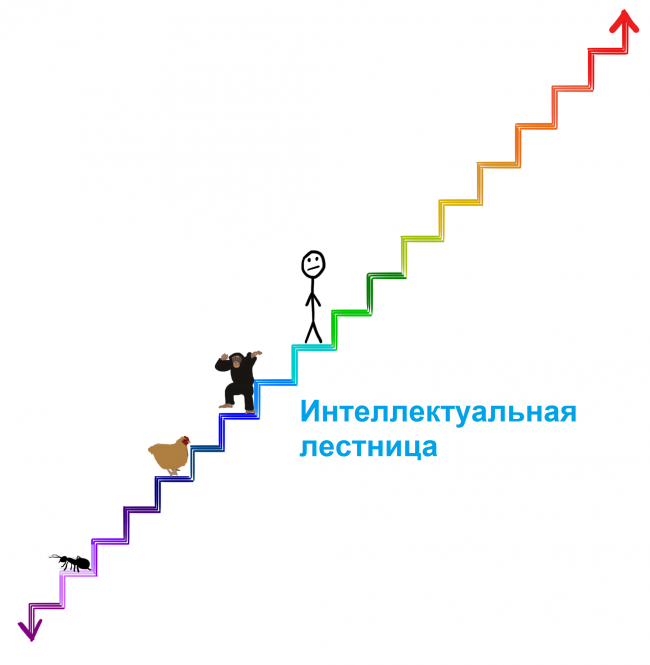

В общей схеме интеллекта, о которой мы говорим, или просто по меркам биологических существ, разница в качестве интеллекта человека и обезьяны крошечная. В предыдущей статье мы разместили биологические когнитивные способности на лесенке:

Чтобы понять, насколько серьезной будет сверхразумная машина, поместите ее на две ступеньки выше, чем человек на этой лестнице. Эта машина может быть сверхразумной совсем чуть-чуть, но ее превосходство над нашими познавательными способностями будет такое же, как наше — над обезьяньими. И как шимпанзе никогда не постигнет, что небоскреб может быть построен, мы можем никогда не понять того, что поймет машина на пару ступенек выше, даже если машина попытается объяснить это нам. А ведь это всего пара ступенек. Машина поумнее увидит в нас муравьев — она будет годами учить нас простейшим с ее позиции вещам, и эти попытки будут совершенно безнадежными.

Тип сверхинтеллекта, о котором мы поговорим сегодня, лежит далеко за пределами этой лестницы. Это взрыв интеллекта — когда чем умнее становится машина, тем быстрее она может увеличивать собственный интеллект, постепенно наращивая обороты. Такой машине могут понадобиться годы, чтобы превзойти шимпанзе в интеллекте, но, возможно, пару часов, чтобы превзойти нас на пару ступенек. С этого момента машина может уже перепрыгивать через четыре ступеньки каждую секунду. Именно поэтому нам стоит понять, что очень скоро после того, как появятся первые новости о том, что машина достигла уровня человеческого интеллекта, мы можем столкнуться с реальностью сосуществования на Земле с чем-то, что будет гораздо выше нас на этой лестнице (а может, и в миллионы раз выше):

И раз уж мы установили, что совершенно бесполезно пытаться понять мощь машины, которая всего на две ступеньки выше нас, давайте определим раз и навсегда, что нет никакого способа понять, что будет делать ИСИ и какими будут последствия этого для нас. Любой, кто заявляет о противоположном, просто не понимает, что означает сверхинтеллект.

Эволюция медленно и постепенно развивала биологический мозг на протяжении сотен миллионов лет, и если люди создадут машину со сверхинтеллектом, в некотором смысле мы превзойдем эволюцию. Или же это будет частью эволюции — возможно, эволюция так и действует, что интеллект развивается постепенно, пока не достигнет переломного момента, предвещающего новое будущее для всех живых существ:

По причинам, которые мы обсудим позже, огромная часть научного сообщества считает, что вопрос не в том, доберемся ли мы до этого переломного момента, а когда.

Где мы окажемся после этого?

Думаю, никто в этом мире, ни я, ни вы, не сможет сказать, что случится, когда мы достигнем переломного момента. Оксфордский философ и ведущий теоретик ИИ Ник Бостром считает, что мы можем свести все возможные результаты к двум большим категориям.

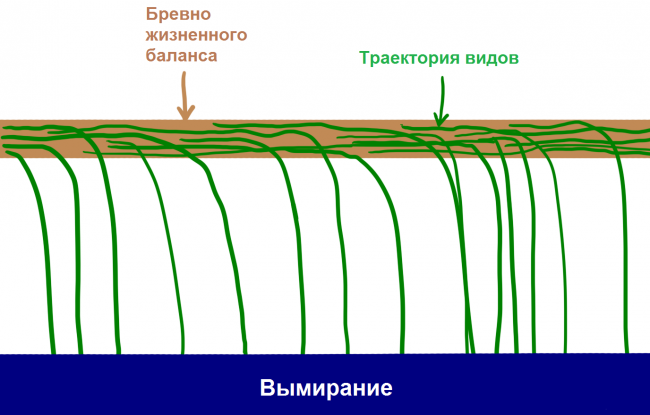

Во-первых, глядя на историю, мы знаем о жизни следующее: виды появляются, существуют определенное время, а затем неизбежно падают с бревна жизненного баланса и вымирают.

«Все виды вымирают» было таким же надежным правилом в истории, как и «все люди когда-нибудь умирают». 99,9% видов упали с жизненного бревна, и совершенно очевидно, что если некоторый вид держится на этом бревне слишком долго, порыв природного ветра или внезапный астероид перевернет это бревно. Бостром называет вымирание состоянием аттрактора — места, на котором все виды балансируют, чтобы не упасть туда, откуда не вернулся пока ни один вид.

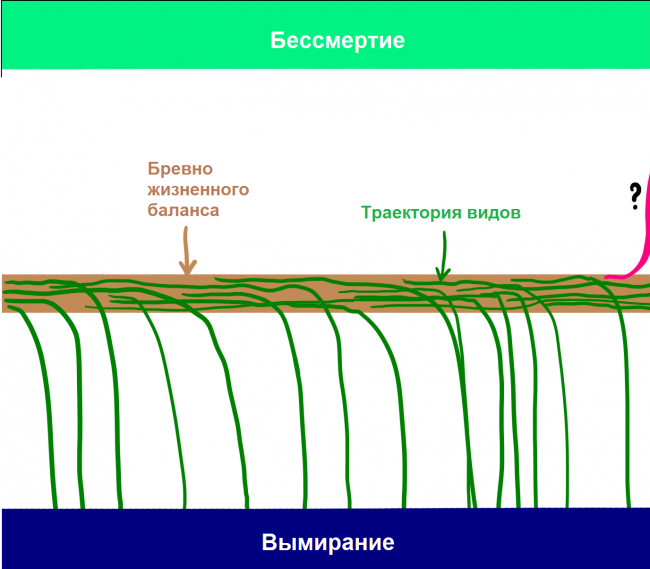

И хотя большинство ученых признают, что у ИСИ будет возможность обречь людей на вымирание, многие также верят, что использование возможностей ИСИ позволит отдельным людям (и виду в целом) достичь второго состояния аттрактора — видового бессмертия. Бостром считает, что бессмертие вида такой же аттрактор, как и вымирание видов, то есть, если мы доберемся до этого, мы будем обречены на вечное существование. Таким образом, даже если все виды до текущего дня падали с этой палки в омут вымирания, Бостром считает, что у бревна есть две стороны, и просто не появился на Земле такой интеллект, который поймет, как упасть на другую сторону.

Если Бостром и другие правы, а, судя по всей доступной нам информации, они вполне могут таковыми быть, нам нужно принять два весьма шокирующих факта:

Появление ИСИ впервые в истории откроет возможность для вида достичь бессмертия и выпасть из фатального цикла вымирания.

Появление ИСИ окажет настолько невообразимо огромное влияние, что, скорее всего, столкнет человечество с этого бревна в одну или другую сторону.

Вполне возможно, что когда эволюция достигает такого переломного момента, она всегда ставит точку в отношениях людей с потоком жизни и создает новый мир, с людьми или без.

Отсюда вытекает один интересный вопрос, который только лентяй не задал бы: когда мы доберемся до этого переломного момента и куда он нас определит? Никто в мире не знает ответа на этот двойной вопрос, но очень много умных людей десятилетиями пытались это понять. Оставшуюся часть статьи мы будем выяснять, к чему они пришли.

Начнем с первой части этого вопрос: когда мы должны достичь переломного момента? Другими словами: сколько осталось времени до тех пор, пока первая машина не достигнет сверхинтеллекта?

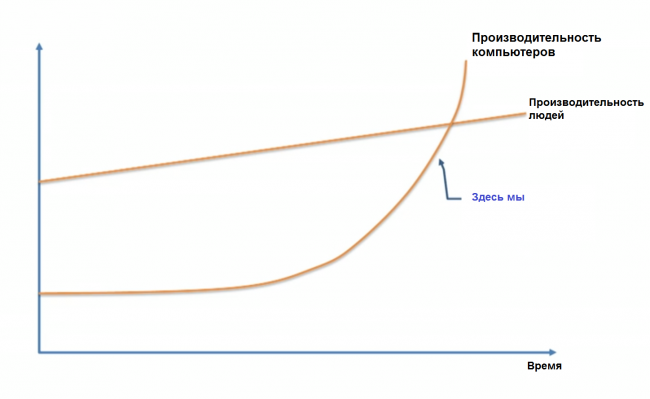

Мнения разнятся от случая к случаю. Многие, среди которых профессор Вернор Виндж, ученый Бен Герцель, соучредитель Sun Microsystems Билл Джой, футуролог Рэй Курцвейл, согласились с экспертом в области машинного обучения Джереми Говардом, когда он представил на TED Talk следующий график:

Эти люди разделяют мнение, что ИСИ появится скоро — этот экспоненциальный рост, который сегодня кажется нам медленным, буквально взорвется в ближайшие несколько десятилетий.

Другие вроде соучредителя Microsoft Пола Аллена, психолога исследований Гари Маркуса, компьютерного эксперта Эрнеста Дэвиса и технопредпринимателя Митча Капора считают, что мыслители вроде Курцвейла серьезно недооценивают масштабы проблемы, и думают, что мы не так-то и близки к переломному моменту.

Лагерь Курцвейла возражает, что единственная недооценка, которая имеет место, — это игнорирование экспоненциального роста, и можно сравнить сомневающихся с теми, кто смотрел на медленно расцветающий интернет в 1985 году и утверждал, что он не будет иметь влияния на мир в ближайшем будущем.

«Сомневающиеся» могут парировать, мол, что прогрессу сложнее делать каждый последующий шаг, когда дело доходит до экспоненциального развития интеллекта, что нивелирует типичную экспоненциальную природу технологического прогресса. И так далее.

Третий лагерь, в котором находится Ник Бостром, не согласен ни с первыми, ни со вторыми, утверждая, что а) все это абсолютно может произойти в ближайшем будущем; и б) нет никаких гарантий в том, что это произойдет вообще или потребует больше времени.

Другие же вроде философа Хьюберта Дрейфуса считают, что все эти три группы наивно полагают, что переломный момент вообще будет, а также что, скорее всего, мы никогда не доберемся до ИСИ.

Что получается, когда мы складываем все эти мнения вместе?

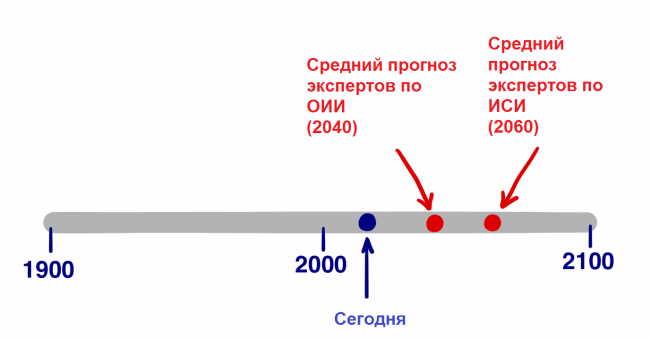

В 2013 году Бостром провел опрос, в котором опросил сотни экспертов в сфере искусственного интеллекта в ходе ряда конференций на следующую тему: «Каков будет ваш прогноз по достижению ОИИ человеческого уровня?» и попросил назвать оптимистичный год (в который мы будем иметь ОИИ с 10-процентным шансом), реалистичное предположение (год, в который у нас с 50-процентной вероятностью будет ОИИ) и уверенное предположение (самый ранний год, в который ОИИ появится с 90-процентной вероятностью). Вот результаты:

* Средний оптимистичный год (10%): 2022

* Средний реалистичный год (50%): 2040

* Средний пессимистичный год (90%): 2075

Среднестатистические опрошенные считают, что через 25 лет мы скорее будем иметь ОИИ, чем нет. 90-процентная вероятность появления ОИИ к 2075 году означает, что если вы сейчас еще довольно молоды, это наверняка произойдет при вашей жизни.

Отдельное исследование, проведенное недавно Джеймсом Барратом (автором нашумевшей и очень хорошей книги «Наше последнее изобретение», отрывки из которой я представлял вниманию читателей Hi-News.ru) и Беном Герцелем на ежегодной конференции, посвященной ОИИ, AGI Conference, просто показало мнения людей относительно года, в который мы доберемся до ОИИ: к 2030, 2050, 2100, позже или никогда. Вот результаты:

* 2030: 42% респондентов

* 2050: 25%

* 2100: 20%

После 2100: 10%

Никогда: 2%

Похоже на результаты Бострома. В опросе Баррата, более двух третей опрошенных считают, что ОИИ будет здесь к 2050 году, и менее половины считают, что ОИИ появится в ближайшие 15 лет. Также бросается в глаза то, что только 2% опрошенных в принципе не видят ОИИ в нашем будущем.

Но ОИИ — это не переломный момент, как ИСИ. Когда, по мнению экспертов, у нас будет ИСИ?

Бостром опросил экспертов, когда мы достигнем ИСИ: а) через два года после достижения ОИИ (то есть почти мгновенно вследствие взрыва интеллекта); б) через 30 лет. Результаты?

Среднее мнение сложилось так, что быстрый переход от ОИИ к ИСИ произойдет с 10-процентной вероятностью, но через 30 лет или меньше он произойдет с 75-процентной вероятностью.

Из этих данных мы не знаем, какую дату респонденты назвали бы 50-процентным шансом появления ИСИ, но на основе двух ответов выше давайте допустим, что это 20 лет. То есть ведущие мировые эксперты из области ИИ считают, что переломный момент настанет в 2060 году (ОИИ появится в 2040 году + понадобится лет 20 на переход от ОИИ к ИСИ).

Конечно, все вышеперечисленные статистики являются спекулятивными и просто представляют мнение экспертов в сфере искусственного интеллекта, но они также указывают, что большинство заинтересованных людей сходятся в том, что к 2060 году ИСИ, скорее всего, должен прибыть. Всего через 45 лет.

Перейдем ко второму вопросу. Когда мы дойдем до переломного момента, по какую сторону фатального выбора нас определит?

Сверхинтеллект будет обладать мощнейшей силой, и критическим вопросом для нас будет следующий:

Кто или что будет контролировать эту силу и какой будет его мотивация?

Ответ на этот вопрос будет зависеть от того, получит ИСИ невероятно мощное развитие, неизмеримо ужасающее развитие или что-то между этими двумя вариантами.

Конечно, сообщество экспертов пытается ответить и на эти вопросы. Опрос Бострома проанализировал вероятность возможных последствий влияния ОИИ на человечество, и выяснилось, что с 52-процентным шансом все пройдет очень хорошо и с 31-процентным шансом все пройдет либо плохо, либо крайне плохо. Опрос, прикрепленный в конце предыдущей части этой темы, проведенный среди вас, дорогие читатели Hi-News, показал примерно такие же результаты. Для относительно нейтрального исхода вероятность составила только 17%. Другими словами, мы все считаем, что появление ОИИ станет грандиозным событием. Также стоит отметить, что этот опрос касается появления ОИИ — в случае с ИСИ, процент нейтральности будет ниже.

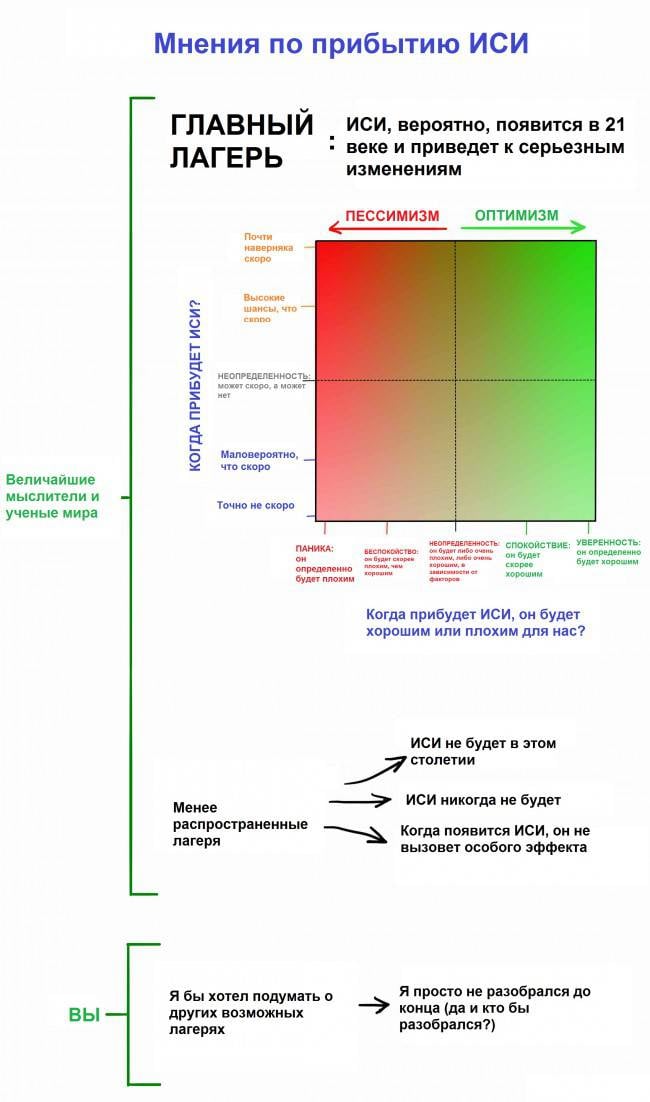

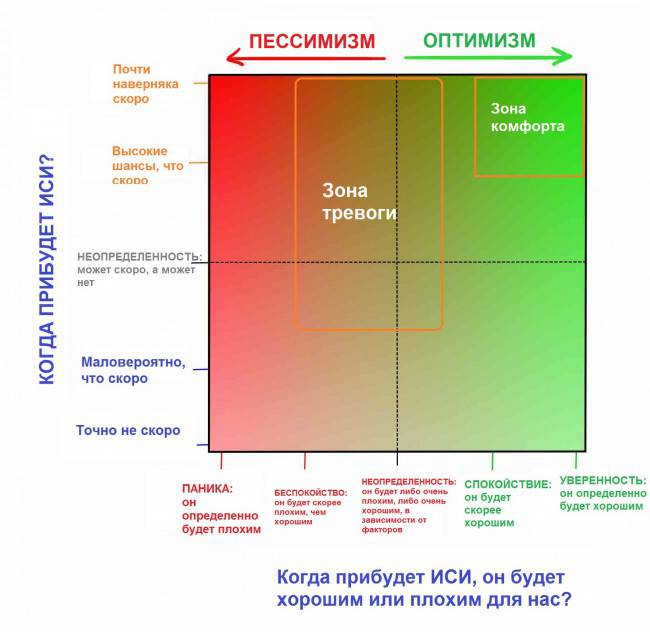

Прежде чем мы углубимся еще дальше в рассуждения о плохой и хорошей сторонах вопроса, давайте объединим обе части вопроса — «когда это произойдет?» и «хорошо это или плохо?» в таблицу, которая охватывает взгляды большинства экспертов.

О главном лагере мы поговорим через минуту, но сначала определитесь со своей позицией. Скорее всего, вы находитесь там же, где и я, до того как стал заниматься этой темой. Есть несколько причин, по которым люди вообще не думают на эту тему:

* Как уже упоминалось в первой части, фильмы серьезно запутали людей и факты, представляя нереалистичные сценарии с искусственным интеллектом, которые привели к тому, что мы вообще не должны воспринимать ИИ всерьез. Джеймс Баррат сравнил эту ситуацию с тем, как если бы Центры по контролю заболеваний выпустили серьезное предупреждение о вампирах в нашем будущем.

* Из-за так называемых когнитивных предубеждений нам очень трудно поверить в реальность чего-то, пока у нас нет доказательств. Можно уверенно представить компьютерщиков 1988 года, которые регулярно обсуждали далеко идущие последствия появления интернета и чем он мог стать, но люди едва ли верили, что он изменит их жизнь, пока этого не случилось на самом деле. Просто компьютеры не умели делать этого в 1988 году, и люди просто смотрели на свои компьютеры и думали: «Серьезно? Это то, что изменит мир?». Их воображение было ограничено тем, чему их научил личный опыт, они знали, что такое компьютер, и было сложно представить, на что компьютер станет способным в будущем. То же самое происходит сейчас с ИИ. Мы слышали, что он станет серьезной штукой, но поскольку пока не столкнулись с ним лицом к лицу и в целом наблюдаем довольно слабые проявления ИИ в нашем современном мире, нам довольно трудно поверить, что он кардинально изменит нашу жизнь. Именно против этих предубеждений выступают многочисленные эксперты из всех лагерей, а также заинтересованные люди: пытаются привлечь наше внимание сквозь шум повседневного коллективного эгоцентризма.

* Даже если бы мы поверили во все это — сколько раз вы сегодня задумывались о том факте, что проведете остаток вечности в небытии? Немного, согласитесь. Даже если этот факт намного важнее всего, чем вы занимаетесь изо дня в день. Все потому, что наши мозги обычно сосредоточены на небольших повседневных вещах, вне зависимости от того, насколько бредовой будет долгосрочная ситуация, в которой мы оказались. Просто мы так устроены.

Одна из целей настоящей статьи — вывести вас из лагеря под названием «Мне нравится думать о других вещах» и поместить в лагерь экспертов, даже если вы просто стоите на распутье между двумя пунктирными линиями на квадрате выше, будучи полностью неопределившимися.

В ходе исследований становится очевидно, что мнения большинства людей быстро уходят в сторону «главного лагеря», а три четверти экспертов попадают в два подлагеря в главном лагере.

Мы полностью посетим оба этих лагеря. Давайте начнем с веселого.

Почему будущее может быть нашей величайшей мечтой?

По мере того, как мы изучаем мир ИИ, мы обнаруживаем на удивление много людей в зоне комфорта. Люди в правом верхнем квадрате гудят от волнения. Они считают, что мы упадем по хорошую сторону бревна, а также уверены, что мы неизбежно к этому придем. Для них будущее — это все только самое лучшее, о чем только можно мечтать.

Пункт, который отличает этих людей от других мыслителей, состоит не в том, что они хотят оказаться на счастливой стороне — а в том, что они уверены, что нас ждет именно она.

Эта уверенность выходит из споров. Критики считают, что она исходит от ослепительного волнения, которое затмевает потенциальные негативные стороны. Но сторонники говорят, что мрачные прогнозы всегда наивны; технологии продолжают и всегда будут помогать нам больше, чем вредить.

Вы вправе выбрать любое из этих мнений, но отложите скептицизм и хорошенько взгляните на счастливую сторону бревна баланса, попытавшись принять тот факт, что все, о чем вы читаете, возможно, уже произошло. Если бы вы показали охотникам-собирателям наш мир уюта, технологий и бесконечного изобилия, им он показался бы волшебным вымыслом — а мы ведем себя достаточно скромно, не в силах допустить, что такая же непостижимая трансформация ждет нас в будущем.

Ник Бостром описывает три пути, по которым может пойти сверхразумная система искусственного интеллекта:

* Оракул, который может ответить на любой точно поставленный вопрос, включая сложные вопросы, на которые люди не могут ответить — к примеру, «как сделать автомобильный двигатель более эффективным?». Google — примитивный тип «оракула».

* Джинн, который выполнит любую команду высокого уровня — использует молекулярный ассемблер, чтобы создать новую, более эффективную версию автомобильного двигателя — и будет ждать следующей команды.

* Суверен, который получит широкий доступ и возможность свободно функционировать в мире, принимая собственные решения и улучшая процесс. Он изобретет более дешевый, быстрый и безопасный способ частного передвижения, нежели автомобиль.

Эти вопросы и задачи, которые кажутся сложными для нас, покажутся сверхразумной системе будто кто-то попросил улучшить ситуацию «у меня карандаш упал со стола», в которой вы просто подняли бы его и положили обратно.

Элиэзер Юдковский, американский специалист по искусственному интеллект, хорошо подметил:

Есть много нетерпеливых ученых, изобретателей и предпринимателей, которые на нашей таблице выбрали себе зону уверенного комфорта, но для прогулки к лучшему в этом лучшем из миров нам нужен только один гид.

Рэй Курцвейл вызывает двоякие ощущения. Некоторые боготворят его идеи, некоторые презирают. Некоторые держатся посередке — Дуглас Хофштадтер, обсуждая идеи книг Курцвейла, красноречиво подметил, что «это как если бы вы взяли много хорошей еды и немного собачьих какашек, а затем смешали все так, что невозможно понять, что хорошо, а что плохо».

Нравятся вам его идеи или нет, мимо них невозможно пройти без тени интереса. Он начал изобретать вещи еще будучи подростком, а в последующие годы изобрел несколько важных вещей, включая первый планшетный сканер, первый сканер, конвертирующий текст в речь, хорошо известный музыкальный синтезатор Курцвейла (первое настоящее электрическое пианино), а также первый коммерчески успешный распознаватель речи. Также он автор пяти нашумевших книг. Курцвейла ценят за его смелые предсказания, и его «послужной список» весьма хорош — в конце 80-х, когда интернет был еще в зачаточном состоянии, он предположил, что к 2000-м годам Сеть станет глобальным феноменом. The Wall Street Journal назвал Курцвейла «беспокойным гением», Forbes — «глобальной думающей машиной», Inc. Magazine — «законным наследником Эдисона», Билл Гейтс — «лучшим из тех, кто прогнозирует будущее искусственного интеллекта». В 2012 году сооснователь Google Ларри Пейдж пригласил Курцвейла на пост технического директора. В 2011 году он стал соучредителем Singularity University, который приютило NASA и который частично спонсирует Google.

Его биография имеет значение. Когда Курцвейл рассказывает о своем видении будущего, это похоже на бред сумасшедшего, но по-настоящему сумасшедшее в этом то, что он далеко не сумасшедший — он невероятно умный, образованный и здравомыслящий человек. Вы можете считать, что он ошибается в прогнозах, но он не дурак. Прогнозы Курцвейла разделяют многие эксперты «комфортной зоны», Питер Диамандис и Бен Герцель. Вот что произойдет, по его мнению.

Хронология

Курцвейл считает, что компьютеры дойдут до уровня общего искусственного интеллекта (ОИИ) к 2029 году, а к 2045 у нас не только будет искусственный сверхинтеллект, но и совершенно новый мир — время так называемой сингулярности. Его хронология ИИ до сих пор считается возмутительно преувеличенной, но за последний 15 лет быстрое развитие систем узконаправленного искусственного интеллекта (УИИ) заставило многих экспертов перейти на сторону Курцвейла. Его предсказания по-прежнему остаются более амбициозными, чем в опросе Бострома (ОИИ к 2040, ИСИ к 2060), но не намного.

По Курцвейлу, к сингулярности 2045 года приводит три одновременных революции в сферах биотехнологий, нанотехнологий и, что более важно, ИИ. Но прежде чем мы продолжим — а нанотехнологии неотрывно следуют за искусственным интеллектом, — давайте уделим минуту нанотехнологиям.

Несколько слов о нанотехнологиях

Нанотехнологиями мы обычно называем технологии, которые имеют дело с манипуляцией материи в пределах 1-100 нанометров. Нанометр — это одна миллиардная метра, или миллионная часть миллиметра; в пределах 1-100 нанометров можно уместить вирусы (100 нм в поперечнике), ДНК (10 нм в ширину), молекулы гемоглобина (5 нм), глюкозы (1 нм) и другое. Если нанотехнологии когда-нибудь станут нам подвластны, следующим шагом будут манипуляции с отдельными атомами, которые меньше всего на один порядок (~,1 нм).

Чтобы понять, где люди сталкиваются с проблемами, пытаясь управлять материей в таких масштабах, давайте перенесемся на больший масштаб. Международная космическая станция находится в 481 километре над Землей. Если бы люди были гигантами и головой задевали МКС, они были бы в 250 000 раз больше, чем сейчас. Если вы увеличите что-то от 1 до 100 нанометров в 250 000 раз, вы получите 2,5 сантиметра. Нанотехнологии — это эквивалент человека высотой с орбиту МКС, который пытается управлять вещами размером с песчинку или глазное яблоко. Чтобы добраться до следующего уровня — управления отдельными атомами — гиганту придется тщательно позиционировать объекты диаметром в 1/40 миллиметра. Обычным людям понадобится микроскоп, чтобы их разглядеть.

Впервые о нанотехнологиях заговорил Ричард Фейнман в 1959 году. Тогда он сказал: «Принципы физики, насколько я могу судить, не говорят против возможности управления вещами атом за атомом. В принципе, физик мог бы синтезировать любое химическое вещество, записанное химиком. Как? Размещая атомы там, где говорит химик, чтобы получить вещество». В этом вся простота. Если вы знаете, как передвигать отдельные молекулы или атомы, вы можете практически все.

Нанотехнологии стали серьезным научным полем в 1986 году, когда инженер Эрик Дрекслер представил их основы в своей фундаментальной книге «Машины создания», однако сам Дрекслер считает, что те, кто хочет узнать больше о современных идеях в нанотехнологиях, должны прочитать его книгу 2013 года «Полное изобилие» (Radical Abundance).

Несколько слов о «серой слизи»

Углубляемся в нанотехнологии. В частности, тема «серой слизи» — одна из не самых приятных тем в области нанотехнологий, о которой нельзя не сказать. В старых версиях теории нанотехнологий был предложен метод наносборки, включающий создание триллионов крошечных нанороботов, которые будут работать совместно, создавая что-то. Один из способов создания триллионов нанороботов — создать одного, который сможет самовоспроизводиться, то есть из одного — два, из двух — четыре и так далее. За день появится несколько триллионов нанороботов. Такова сила экспоненциального роста. Забавно, не так ли?

Забавно, но ровно до тех пор, пока не приведет к апокалипсису. Проблема в том, что сила экспоненциального роста, которая делает довольно удобным способ быстрого создания триллиона наноботов, делает саморепликацию страшной штукой в перспективе. Что, если система заглючит, и вместо того, чтобы остановить репликацию на паре триллионов, наноботы продолжат плодиться? Что, если весь этот процесс зависит от углерода? Биомасса Земли содержит 10^45 атомов углерода. Нанобот должен состоять из порядка 10^6 атомов углерода, поэтому 10^39 наноботов сожрут всю жизнь на Земле, и это случится всего за 130 репликаций. Океан наноботов («серая слизь») наводнит планету. Ученые думают, что наноботы смогут реплицироваться за 100 секунд, а это значит, что простая ошибка может убить всю жизнь на Земле всего за 3,5 часа.

Может быть и хуже — если до нанотехнологий дойдут руки террористов и неблагоприятно настроенных специалистов. Они могли бы создать несколько триллионов наноботов и запрограммировать их тихо распространиться по миру за пару недель. Затем, по одному нажатию кнопки, всего за 90 минут они съедят вообще все, без шансов.

Хотя эта страшилка широко обсуждалась в течение многих лет, хорошая новость в том, что это всего лишь страшилка. Эрик Дрекслер, который ввел термин «серая слизь», на днях рассказал следующее: «Люди любят страшилки, и эта входит в разряд страшилок о зомби. Эта идея сама по себе уже ест мозги».

После того как мы доберемся до самого низа нанотехнологий, мы сможем использовать их для создания технических устройств, одежды, еды, биопродуктов — клеток крови, борцов с вирусами и раком, мышечных тканей и т. п. — чего угодно. И в мире, который использует нанотехнологии, стоимость материала больше не будет привязана к его дефициту или сложности процесса его изготовления, а скорее к сложности атомной структуры. В мире нанотехнологий алмаз может стать дешевле ластика.

Мы пока и близко не там. И не совсем понятно, недооцениваем мы или переоцениваем сложность этого пути. Однако все идет к тому, что нанотехнологии не за горами. Курцвейл предполагает, что уже к 2020-м годам они у нас будут. Мировые государства знают, что нанотехнологии могут обещать грандиозное будущее, и поэтому инвестируют в них многие миллиарды.

Просто представьте, какие возможности получит сверхразумный компьютер, если доберется до надежного наномасштабного ассемблера. Но нанотехнологии — это наша идея, и мы пытаемся ее оседлать, нам сложно. Что, если для системы ИСИ они будут просто шуткой, и сам ИСИ придумает технологии, которые будут в разы мощнее всего, что мы вообще в принципе можем предположить? Мы же договорились: никто не может предположить, на что будет способен искусственный сверхинтеллект? Есть мнение, что наши мозги неспособны предсказать даже минимума из того, что будет.

Что ИИ мог бы сделать для нас?

Вооружившись сверхинтеллектом и всеми технологиями, которые мог бы создать сверхинтеллект, ИСИ будет в состоянии, вероятно, решить все проблемы человечества. Глобальное потепление? ИСИ сначала прекратит выбросы углекислого газа, придумав массу эффективных способов добычи энергии, не связанных с ископаемым топливом. Затем он придумает эффективный инновационный способ удаления избытка CO2 из атмосферы. Рак и другие заболевания? Не проблема — здравоохранение и медицина изменятся так, что невозможно представить. Мировой голод? ИСИ будет использовать нанотехнологии для создания мяса, идентичного натуральному, с нуля, настоящее мясо.

Нанотехнологии смогут превратить груду мусора в чан свежего мяса или другой еды (необязательно даже в привычной форме — представьте гигантский яблочный куб) и распространить всю эту еду по миру, используя продвинутые системы транспортировки. Конечно, это будет замечательно для животных, которым больше не придется умирать ради еды. ИСИ также может сделать много другого вроде сохранения вымирающих видов или даже возврата уже вымерших по сохраненной ДНК. ИСИ может разрешить наши самые сложные макроэкономические проблемы — наши самые сложные экономические дебаты, вопросы этики и философии, мировой торговли — все это будет мучительно очевидно для ИСИ.

Но есть кое-что особенное, что ИСИ мог бы сделать для нас. Манящее и дразнящее, что изменило бы все: ИСИ может помочь нам справиться со смертностью. Постепенно постигая возможности ИИ, возможно, и вы пересмотрите все свои представления о смерти.

У эволюции не было никаких причин продлевать нашу продолжительность жизни больше, чем она есть сейчас. Если мы живем достаточно долго, чтобы нарожать и воспитать детей до того момента, когда они смогут постоять за себя, эволюции этого достаточно. С эволюционной точки зрения, 30+ лет для развития достаточно, и нет никаких причин для мутаций, продлевающих жизнь и снижающих ценность естественного отбора. Уильям Батлер Йетс назвал наш вид «душой, прикрепленной к умирающему животному». Не очень-то весело.

И поскольку все мы когда-нибудь умираем, мы живем с мыслью о том, что смерть неизбежна. Мы думаем о старении со временем — продолжая двигаться вперед и не имея возможности остановить этот процесс. Но мысль о смерти вероломна: захваченные ею, мы забываем жить. Ричард Фейнман писал:

«В биологии есть замечательная вещь: в этой науке нет ничего, что говорило бы о необходимости смерти. Если мы хотим создать вечный двигатель, мы понимаем, что обнаружили достаточно законов в физике, которые либо указывают на невозможность этого, либо на то, что законы ошибочны. Но в биологии нет ничего, что указывало бы на неизбежность смерти. Это приводит меня к мысли, что она не так уж и неизбежна, и остается только вопрос времени, прежде чем биологи обнаружат причину этой проблемы, этого ужасного универсального заболевания, оно будет излечено».

Дело в том, что старение никак не связано со временем. Старение заключается в том, что физические материалы тела изнашиваются. Части автомобиля тоже деградируют — но разве это старение неизбежно? Если вы будете ремонтировать автомобиль по мере изнашивания частей, он будет работать вечно. Человеческое тело ничем не отличается — просто более сложное.

Курцвейл говорит о разумных, подключенных к Wi-Fi наноботах в кровотоке, которые могли бы выполнять бесчисленные задачи для человеческого здоровья, включая регулярный ремонт или замену изношенных клеток в любой части тела. Если усовершенствовать этот процесс (или найти альтернативу, предложенную более умным ИСИ), он не только будет поддерживать тело здоровым, он может обратить вспять старение. Разница между телом 60-летнего и 30-летнего заключается в горстке физических моментов, которые можно было бы исправить при наличии нужных технологий. ИСИ мог бы построить машину, в которую человек бы заходил 60-летним, а выходил 30-летним.

Даже деградирующий мозг можно было бы обновить. ИСИ наверняка знал бы, как проделать это, не затрагивая данные мозга (личность, воспоминания и т. д.). 90-летний старик, страдающий от полной деградации мозга, мог бы пройти переподготовку, обновиться и вернуться в начало своей жизненной карьеры. Это может показаться абсурдным, но тело — это горстка атомов, и ИСИ наверняка мог бы с легкостью ими манипулировать, любыми атомными структурами. Все не так абсурдно.

Курцвейл также считает, что искусственные материалы будут интегрироваться в тело все больше и больше по мере движения времени. Для начала органы можно было бы заменить сверхпродвинутыми машинными версиями, которые работали бы вечно и никогда не подводили. Затем мы могли бы провести полный редизайн тела, заменить красные кровяные клетки идеальными наноботами, которые двигались бы самостоятельно, устранив необходимость в сердце вообще. Мы также могли бы улучшить наши когнитивные способности, начать думать в миллиарды быстрее и получить доступ ко всей доступной человечеству информации с помощью облака.

Возможности для постижения новых горизонтов были бы воистину безграничными. Людям удалось наделить секс новым назначением, они занимаются им для удовольствия, а не только для воспроизводства. Курцвейл считает, что мы можем проделать то же самое с едой. Наноботы могли бы доставлять идеальное питание прямо в клетки тела, позволяя нездоровым веществам проходить через тело насквозь. Теоретик нанотехнологий Роберт Фрейтас уже разработал замену кровяным клеткам, которые, будучи имплементированными в тело человека, могут позволить ему не дышать в течение 15 минут — и это придумал человек. Представьте, когда власть получит ИСИ.

В конце концов, Курцвейл считает, что люди достигнут точки, когда станут полностью искусственными; времени, когда мы будем смотреть на биологические материалы и думать о том, насколько примитивными были; времени, когда мы будем читать о ранних этапах истории человечества, поражаясь тому, как микробы, несчастные случаи, заболевания или просто старость могли убить человека против его воли. В конечном итоге люди победят собственную биологию и станут вечными — таков путь по счастливую сторону бревна баланса, о котором мы говорим с самого начала. И люди, которые в это верят, уверены также и в том, что нас ждет такое будущее очень и очень скоро.

Вы наверняка не будете удивлены тому, что идеи Курцвейла вызвали суровую критику. Его сингулярность в 2045 году и последующая вечная жизнь для людей получили название «вознесение ботаников» или «разумное создание людей с IQ 140». Другие усомнились в оптимистичных временных рамках, понимании тела и мозга человека, напомнили о законе Мура, который пока никуда не девается. На каждого эксперта, который верит в идеи Курцвейла, приходится три, которые считают, что он ошибается.

Но самое интересное в этом то, что большинство экспертов, не согласных с ним, в целом не говорят, что это невозможно. Вместо того чтобы сказать «ерунда, такого никогда не случится», они говорят что-то вроде «все это случится, если мы доберемся до ИСИ, но загвоздка как раз в этом». Бостром, один из признанных экспертов ИИ, предупреждающих об опасности ИИ, также признает:

«Едва ли останется хоть какая-нибудь проблема, которую сверхинтеллект не в силах будет разрешить или хотя бы помочь нам решить. Болезни, бедность, разрушение окружающей среды, страдания всех видов — все это сверхинтеллект при помощи нанотехнологий сможет решить в момент. Также сверхинтеллект может дать нам неограниченный срок жизни, остановив и обратив вспять процессы старения, используя наномедицину или возможность загружать нас в облако. Сверхинтеллект также может создать возможности для бесконечного увеличения интеллектуальных и эмоциональных возможностей; он может посодействовать нам в создании мира, в котором мы будем жить в радости и понимании, приближаясь к своим идеалам и регулярно воплощая свои мечты».

Это цитата одного из критиков Курцвейла, однако, признающего, что все это возможно, если нам удастся создать безопасный ИСИ. Курцвейл просто определил, каким должен стать искусственный сверхинтеллект, если он вообще станет возможным. И если он будет добрым богом.

Наиболее очевидная критика сторонников «зоны комфорта» заключается в том, что они могут чертовски ошибаться, оценивая будущее ИСИ. В своей книге «Сингулярность» Курцвейл посвятил 20 страниц из 700 потенциальным угрозам ИСИ. Вопрос не в том, когда мы доберемся до ИСИ, вопрос в том, какой будет его мотивация. Курцвейл отвечает на этот вопрос с осторожностью: «ИСИ вытекает из многих разрозненных усилий и будет глубоко интегрирован в инфраструктуру нашей цивилизации. По сути, он будет тесно встроен в наш организм и мозг. Он будет отражать наши ценности, потому что будет с нами одним».

Но если ответ таков, почему так много умных людей в этом мире обеспокоены будущим искусственного интеллекта? Почему Стивен Хокинг говорит, что разработка ИСИ «может означать конец человеческой расы»? Билл Гейтс говорит, что он «не понимает людей, которые не обеспокоены» этим. Элон Маск опасается, что мы «призываем демона». Почему многие эксперты считают ИСИ самой большой угрозой для человечества?

Об этом мы поговорим в следующий раз.

По материалам waitbutwhy.com, компиляция Тима Урбана. В статье использованы материалы работ Ника Бострома, Джеймса Баррата, Рэя Курцвейла, Джея Нильс-Нильссона, Стивена Пинкера, Вернора Винджа, Моше Варди, Расса Робертса, Стюарта Армстрога и Кая Сотала, Сюзан Шнайдер, Стюарта Рассела и Питера Норвига, Теодора Модиса, Гари Маркуса, Карла Шульмана, Джона Серля, Джарона Ланье, Билла Джоя, Кевина Кели, Пола Аллена, Стивена Хокинга, Курта Андерсена, Митча Капора, Бена Герцел, Артура Кларка, Хьюберта Дрейфуса, Теда Гринвальда, Джереми Говарда.

Информация